Quand l'IA déçoit : aperçu des dernières fissures du mythe technophile

Fermeture de Sora, robotaxis qui dérapent, panne de l'investissement dans les data centers, agents IA générateurs d'erreurs... les promesses de la Tech face au mur de la réalité.

Si vous avez l’impression que l’IA est sur le point de vous remplacer et que 2027 sera l’année des robots, j’ai des nouvelles pour vous.

Contrairement à ce que suggère le torrent d’information anxiogène sur le sujet, tout n’est pas rose dans le secteur de la Tech. Ces dernières semaines, le programme de Robotaxis de Tesla a subi un revers, OpenAI a annulé son service de génération de vidéo « Sora » et les “agents” IA ont provoqué des dégâts considérables chez Facebook et Amazon. Des contrecoups qui interviennent dans un contexte inédit de baisse du rythme de déploiement des data centers aux États-Unis, signe supplémentaire de l’essouflement du secteur.

Si les annonces fracassantes peuvent donner l’impression d’un rouleau compresseur technologique, gardez à l’esprit que la Tech dépend des promesses fumeuses pour attirer les investisseurs et convaincre le grand public comme les entreprises d’acheter leurs produits. Pour se remettre les idées en place, je vous propose un petit tour d’horizon des récentes déconvenues du secteur.

Des robotaxis pas si autonomes

La promesse de la voiture autonome ne date pas d’hier. Des millions d’emplois (taxis, VTC, livreurs, conducteur de bus, chauffeur de poids lourds…) seraient menacés par une technologie qui risque également de concurrencer les transports en commun. En transformant les véhicules particuliers en taxis à bas cout, comme l’envisageait Musk dans son « Master Plan, part 2 », tout le parc automobile pourrait concurrencer Uber.

Malgré le retard à l’allumage, cette dystopie semble de plus en plus plausible. Les robotaxis de Waymo, filiale de Google, ont démontré la viabilité technique de leur solution. L’entreprise déploie son service dans un nombre croissant de mégalopoles américaines, avec un taux d’accident inférieur à la moyenne humaine par millions de kilomètres parcourus. Un succès qui provoque de nombreuses frictions.

Waymo fait l’objet de deux enquêtes administratives américaines suite à des difficultés manifestées par ses voitures pour gérer les conditions de circulation impliquant des bus de ramassage scolaire. En janvier, une enfant a ainsi été percutée par une voiture autonome. Cette affaire s’ajoute à des différents problèmes liés aux difficultés posés par les situations inhabituelles de circulations Récemment, une Waymo a bloqué des policiers mobilisés pour répondre à une fusillade de masse à Austin. Avant cela, une autre Waymo avait bloqué une ambulance en intervention. Il ne s’agit pas de cas isolés, mais d’un problème structurel. À San Fransisco, les pouvoirs publics se plaignent de devoir jouer les dépanneurs gratuits de robotaxis. En effet, les pompiers, policiers et agents de la circulation sont souvent contrain de venir en aide à une Waymo en difficultée, pour l’empêcher de bloquer trop longtemps la circulation.

Si ces difficultés ne semblent pas en mesure d’entraver l’expansion des Robotaxis, le le modèle commercial de Waymo présente d’autres limitations. Pour maintenir sa performance en matière de sécurité routière, la start-up déploie uniquement ses taxis autonomes sur des itinéraires balisés, après avoir acquis suffisamment d’expérience en phase de test. Chaque nouveau déploiement nécessite des investissements importants pour cartographier la nouvelle zone qui sera desservie et entrainer le système de conduite à l’emprunter.

Est-il moins cher d’employer un automate Waymo qu’un humain ? À en croire les prix pratiqués par l’entreprise, supérieurs aux courses Uber avec chauffeur, la réponse serait non. Une part des explications réside dans le cout des voitures, produites en moins grand nombre d’exemplaires et munies de capteurs additionnels onéreux. L’autre raison vient d’être confirmée par l’entreprise lors d’une audition devant le Sénat américain :

Les Waymo ne sont pas autonomes.

Plus exactement, des humains interviennent dans la boucle. Ils ne conduisent pas la voiture, mais surveillent la flotte et répondent aux requêtes de l’IA lorsque celle-ci se trouve confronté à une situation difficile. Le ratio humain/voiture tend à se réduire. Après avoir été longtemps évasif sur le sujet, Waymo vient de lâcher un chiffre : l’entreprise emploierait un téléopérateur pour 42 voitures. Un faible ratio, mais non négligeable.

Ces téléopérateurs ont un cout et posent divers problèmes. Certains sont localisés aux Philippines, sans être nécessairement en possession d’un permis de conduire américain. Outre les risques en matière de piratage informatique, le choix de sous-traiter à ce point montre une absence manifeste de contrôle et de régulation. Dans tous les cas, la nécessité de maintenir des humains dans la boucle introduit une limite à la croissance exponentielle du service. Ce qui nous amène aux déboires de Tesla.

Comme j’avais eu l’occasion de le détailler dans un article dédié, l’entreprise de Musk a opté pour une approche radicalement différente, au prix de dizaines de morts et centaines d’accidents. L’objectif initial consistait à rendre toutes les Tesla autonomes, dans le but de permettre aux propriétaires de convertir leurs véhicules en robotaxis occasionnels.

Face aux difficultés rencontrés, Tesla a changé son fusil d’épaule en démarrant en grande pompe un service de robotaxis inspiré de Waymo. La première phase de test, lancée dans la ville d’Austin à l’aide d’une vingtaine de véhicules, devait permettre de démontrer la fiabilité du système en vue d’un déploiement exponentiel. Pas besoin de produire des voitures spécifiques, pas besoin de passer des mois à cartographier une ville et à entrainer le modèle à la parcourir. Waymo n’avait qu’à bien se tenir. La requête déposée devant les autorités routières californiennes pour l’obtention d’une licence de robotaxis alimentait ce récit conquérant.

Hélas pour Musk, les choses ne se passent pas tout à fait comme prévu. Non seulement la phase de test a majoritairement été conduite avec un employé à bord du robotaxi. Mais en plus, Tesla a reconnu que ses robotaxis provoquaient trois fois plus de collisions qu’un conducteur humain.

Or, les données partagées par l’entreprise avec les autorités locales n’incluent pas les nombreuses violations du Code de la route constatées par des observateurs. Là où Waymo s’illustre par sa transparence, Tesla continue d’opérer dans la plus grande opacité, en refusant de fournir le moindre détail sur les circonstances de ses accidents. On ne sait pas davantage à quelle fréquence ses copilotes humains prennent le controle du vehicule ni quel est le ratio entre téléopérateurs et robotaxis. Tout ce que l’on sait, c’est que la firme avait retiré ses copilotes humains pendant deux jours, probablement pour rassurer les marchés financiers lors de la publication des résultats annuels, avant de les replacer derrière le volant.

Les nouvelles ne sont pas meilleures du côté de l’autopilote fourni en option sur toutes les Tesla. Le système FSD (pour « Full Self Driving ») qui permet au conducteur de lâcher le volant quelques secondes multiplie les dérapages. La propriétaire d’un Cybertruck vient d’attaquer Tesla en justice. Elle accuse la firme d’avoir provoqué un accident, l’autopilote conduisant son véhicule en plein dans la barrière en béton séparant deux bretelles d’autoroutes. Une autre Tesla a récemment tenté de traverser un lac.

Ce genre de problème n’afflige pas uniquement les voitures autonomes. Les robots livreurs connaissent également leur lot d’accidents. Lorsqu’ils ne sont pas interdits de circulation par des pouvoirs publics pliant face à la colère des riverains, ils ont tendance à détruire des jardins ou traverser des vitres d’abribus. On pourrait également citer la multiplication de cas impliquant des systèmes de vidéosurveillance ayant conduit à des arrestations injustifiés, voire des séjours prolongés en prison, suite à des erreurs d’identification.

De là à dire que les millions de robotaxis autonomes ne sont pas pour demain, il y a un pas que j’hésite à franchir. D’autres constructeurs automobiles ont mis au point des systèmes d’assistance à la conduite prometteurs et la technologie se perfectionne avec le temps. Mais le dernier « kilomètre » reste le plus dur à parcourir. Celui qui sépare un système d’assistance à la conduite d’une véritable voiture sans pilote capable d’opérer de manière plus fiable qu’un humain. Et, si possible, sans engendrer de multiples conséquences négatives pour les autres usagers.

Les “agents IA” générateurs de catastrophes

Dans le domaine de l’IA générative, tout le monde admet que l’approche reposant sur les larges modèles de langage se heurte à un mur, y compris les patrons de Google et d’OpenAI. Plutôt que de poursuivre leur quête d’une IA générale toute puissante, ils se focalisent désormais sur des applications plus spécifiques et susceptibles de leur permettre d’atteindre la rentabilité. D’où les efforts pour améliorer les fonctionnalités permettant d’écrire du code informatique et le déploiement hâtif de programmes appelés « agents ».

Ces “agents” sont capables de prendre le contrôle de votre ordinateur ou de certains logiciels pour effectuer des tâches de manière autonome (envoyer des courriels, mettre en ligne un site web, etc.). Si les dernières versions de ces programmes semblent plus prometteuses que les flops initiaux, des ratés monumentaux continuent de faire les gros titres.

Chez Facebook, un agent a provoqué un accident en postant des informations sur le site interne de l’entreprise. Dans un autre épisode non dénué d’ironie, la directrice de la sécurité IA de Meta a perdu tous ses courriels, effacés par un agent mal programmé.

Chez Amazon, l’usage immodéré des IA a provoqué l’arrêt temporaire de plusieurs serveurs indispensables au bon fonctionnement de la boutique en ligne. Les multiples problèmes ont entrainé la perte de millions de commandes et la suspension du site pendant plusieurs heures en Amérique du Nord, principal marché d’Amazon. Le média spécialisé The Information explique ainsi que le déploiement des Agents introduit de nombreuses failles de sécurité et des mécanismes de pannes logicielles inédits.

Dans la même veine, notre camarade Hubert Guillaud relate les conclusions d’une étude finlandaise illustrant pourquoi les déploiements de systèmes décisionnels reposant sur de l’IA générative se soldent souvent par des échecs opérationnels.

Ces exemples expliquent pourquoi Anthropic s’est préventivement déchargé de sa responsabilité concernant l’usage de Claude Cowork, son tout dernier agent. Si vous connaissez d’autres entreprises qui mettent des produits sur le marché en déclarant que les clients s’exposent à de graves dangers, faites-moi signe. De mémoire, on n’a jamais lu un chapeau d’article type : « Lustucru lance ses nouveaux spaghettis, cuits en deux minutes. La firme avertie que leur consommation peut entrainer des maladies graves ». Mais avec la Tech, tout est permis.

L’IA générative ne génère pas les gains de productivité escomptés

Non seulement l’usage intensif de l’IA rend idiot, mais elle pousse également les employés au burn-out. L’auteur d’une étude de Berkley, cité par le Wall Street Journal, explique que l’IA augmente le volume de travail attendu des employés, qui se sentent sous pression et profitent de ses outils pour effectuer plus de tâches, « aux dépens du temps de réflexion et des activités demandant une plus grande concentration ». Et de noter que « si cela peut paraitre bénéfique à l’employeur à court terme, à moyen terme cela peut conduire à des burn-out, des pertes d’aptitudes cognitives ou impacter négativement la prise de décision de qualité ».

La question des gains de productivité continue de faire débat. Selon une autre enquête menée auprès de 6000 PDG par le National Bureau of Economic Research, 90 % des grands patrons interrogés estiment que l’IA n’avait pas eu d’impact sur la productivité ou l’emploi dans leur entreprise. Tout en reconnaissant utiliser eux-mêmes ces outils seulement « moins de 1h30 par semaine ».

Ces enquêtes viennent nuancer le genre de récits et discours alarmistes qui prétendent que l’IA remplace des millions d’emplois. D’autres signaux pointent vers les limites de cette technologie, trop souvent présentée comme incontournable et inévitable.

OpenAI vient de mettre fin à deux produits importants. Le premier visait à instaurer une fonction de commerce en ligne dans ChatGPT. Puisque les utilisateurs du chatbot demandent souvent des conseils en matière de shopping, OpenAI pensait monétiser cet usage en mettant en relation ses usagers avec divers sites de vente en ligne. Seul problème, maintenir un tel service sans provoquer d’innombrables erreurs (prix pas à jour, produit non conforme à la description ou plus disponible) générant des retours clients ou empêchant la conclusion d’une transaction demande des quantités de données et une infrastructure gigantesque. Ce qu’OpenAI n’est pas en mesure de fournir à l’heure actuelle.

L’annonce de l’abandon de ce service a revigoré les cours boursiers des principales agences de voyages (Expedia, Booking,…) qui avaient peur que des « agents » reposant sur l’IA générative ne sapent leur modèle commercial.

Cet échec n’est pas le seul récemment acté par OpenAI. Le leader de l’IA générative vient d’annoncer la suppression de « Sora », son service de génération de vidéo qui avait défrayé la chronique. Pris de court, Walt Disney a annulé son investissement d’un milliard de dollars dans OpenAI. Le partenariat devait permettre à Sora d’utiliser gratuitement les personnages de Disney sans verser de droits d’auteur.

Les raisons de cette suppression ne sont pas claires. Elle constitue un élément supplémentaire suggérant qu’OpenAI traverse de graves difficultés, alors que ses produits sont dépassés par la concurrence et que son image s’est sérieusement dégradée. Pour Sora, on peut supposer que le service coutait trop cher à OpenAI, alors qu’il était utilisé principalement pour produire du contenu pornographique, de la désinformation et du slop plus ou moins manipulatoire. Loin d’avoir entrainé la mort d’Holywood, Sora n’a pas trouvé d’application commerciale convaincante.

AMC, principal opérateur de salles de cinémas aux États-Unis, vient de retirer en catastrophe de ses salles un court métrage réalisé par l’IA. Le spot, diffusé pendant les publicités d’avant séance, avait enragé les clients. AMC a pointé la responsabilité d’un sous-traitant chargé de gérer la régie publicitaire d’un tiers de ses cinémas pour tenter d’apaiser le public. Une preuve de plus du dégout qu’inspire l’usage de l’IA dans la production audiovisuelle.

Le déploiement des data centers en panne

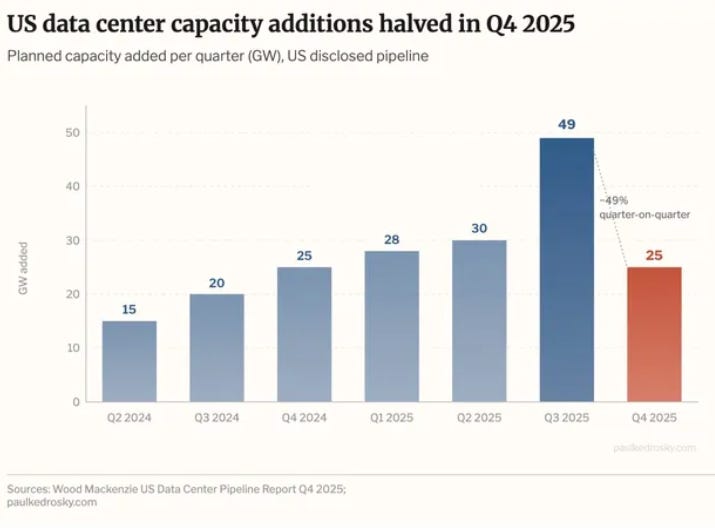

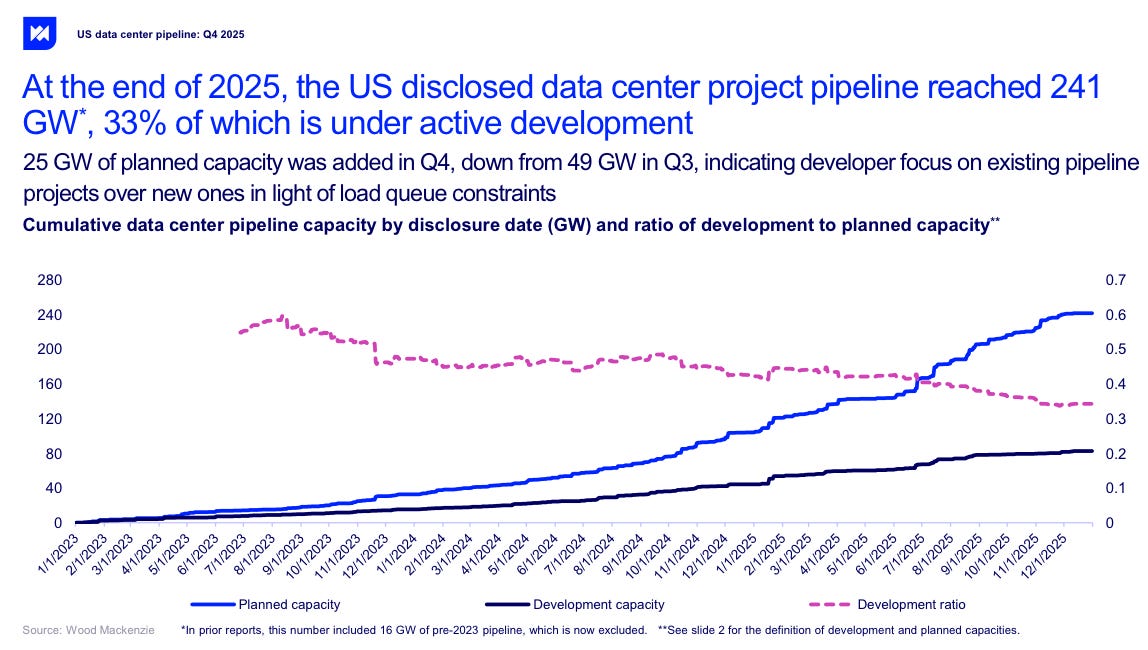

Comme le résume Ed Zitron dans sa newsletter, le dernier rapport du cabinet Wood Mackenzie révèle une baisse spectaculaire des projets de data centers au cours du dernier trimestre. Ce ralentissement intervient au momement où les difficultés pour mener à termes ces projets s’accumulent. Sur les 240GW de puissance promis aux USA (l’équivalent de la puissance requise lors des pics de consommation électrique du pays), seuls 33 % sont en cours de construction. La principale raison invoquée découle des difficultés à mettre en ligne un data center.

L’opposition à leur implantation est de plus en plus féroce, les riverains craignant les impacts en termes de consommation d’eau et de hausse du prix de l’électricité, alors que les emplois créés se comptent souvent sur les doigts de la main. De nombreux projets ont été annulés ou retardés. Et ceux qui sont autorisés butent parfois sur des problèmes d’approvisionnement en composants, lorsqu’ils ne rencontrent pas des difficultés à se raccorder au réseau ou à trouver leur propre source d’énergie. Ainsi, 58% des projets planifiés n’ont pas sécurisé leur accès à la puissance électrique nécessaire pour les faire tourner.

Mais le point essentiel à retenir est peut-être ailleurs : les chiffres ne concernent pas la mise en service des data centers, mais simplement les projets déclarés. La quantité de data centers qui sont effectivement mis en fonctionnement chaque trimestre est largement inférieure aux chiffres époustouflants repris par la presse. Une fois de plus, il existe un gouffre entre les promesses et la réalité.

Tous ces éléments mis bout à bout forment un panorama quelque peu différent de celui produit par notre système médiatique. En plus de buter sur des problèmes commerciaux et techniques, l’adoption massive de l’IA pourrait se heurter aux limites physiques induites par le caractère extrêmement énergivore de l’infrastructure sous-jacente. En attendant la publication d’un hypothétique ouvrage intitulé « Comment saboter un data center », il est possible de faire sa part en s’opposant activement à l’implantation de ces infrastructures autour de nous.

Merci beaucoup pour cette publication techno-critique qui fait du bien en cette période de grotesque fascination unanime pour une « innovation » pourtant incroyablement néfaste pour l’humanité !